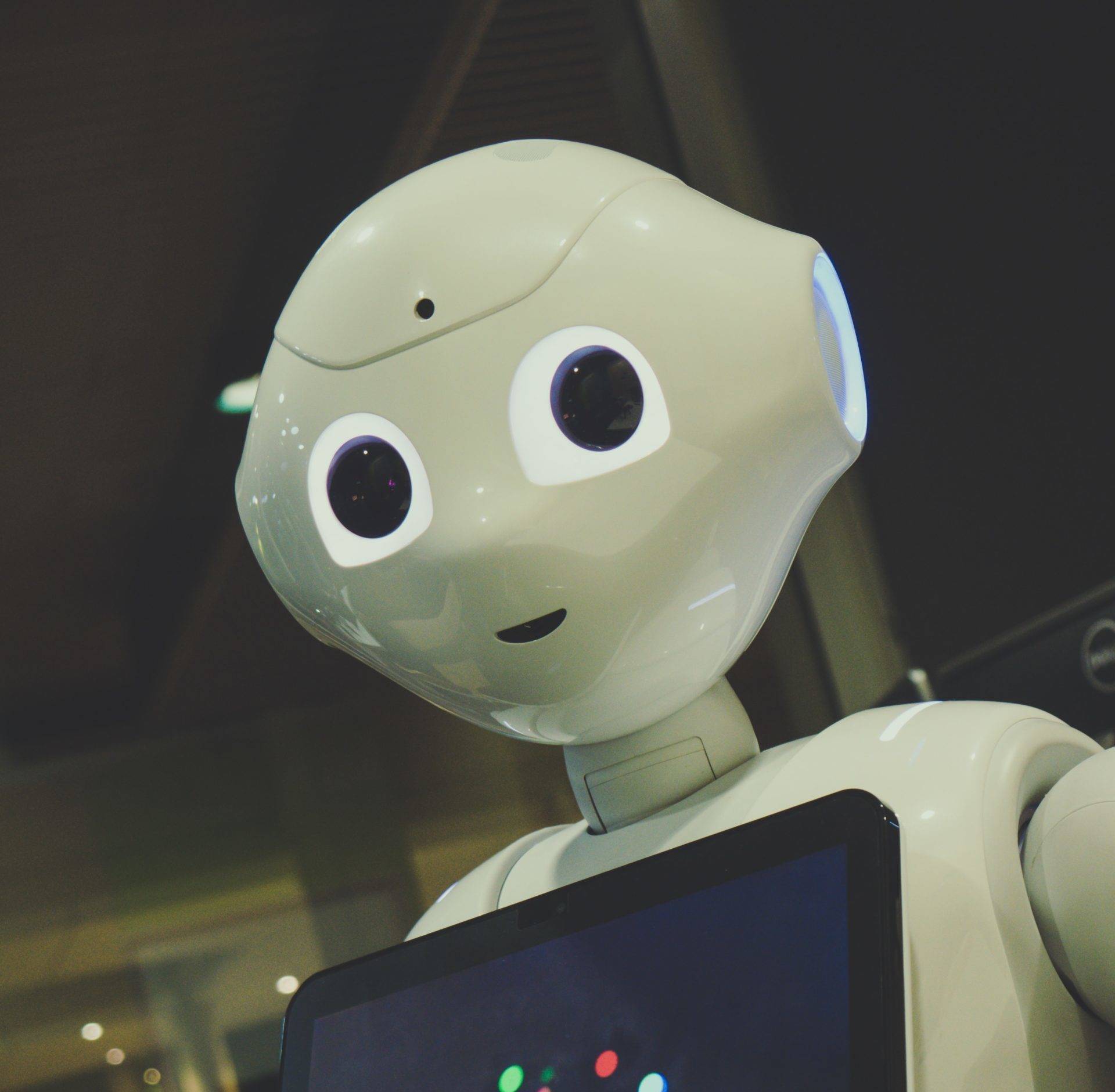

L’intelligence artificielle, secteur scientifique en expansion et de plus en présent dans le quotidien, fait l’objet d’autant de préoccupations que de fantasmes quant à son développement et ses usages futurs. De fait, l’usage de l’intelligence artificielle à des fins militaires pourrait bien gagner en importance – à voir s’il faut le souhaiter ou le redouter.

Si l’intelligence artificielle (IA) est utilisée de manière croissante dans la société civile, le domaine militaire n’est pas en reste. Les robots tueurs et les armes autonomes sont les sujets les plus marquants, mais l’IA ne s’arrête pas là. Le développement de l’IA et son impact au quotidien sont comparables à l’arrivée de l’informatique dans les années 1960-70.

Présentation de l’intelligence artificielle

Depuis plusieurs années, l’intelligence artificielle occupe une place croissante dans notre quotidien. Il en existe des usages variés, dans de nombreux domaines. Dans la finance, l’IA est utilisée pour la détection de fraude. Un programme d’IA a aidé à l’atterrissage de Perseverance sur Mars. Dans l’art, elle est capable de transformer des tableaux en animation vidéo[1]. Ces applications et de nombreuses autres apparaissent presque magiques tant elles repoussent les frontières habituelles de l’informatique et du numérique.

Cependant, la technologie d’IA est plus ancienne qu’on pourrait le croire, le terme ayant été utilisé pour la première fois en 1956 durant une conférence à Dartmouth. Sa naissance est donc simultanée au début de l’informatique, mais son usage est resté marginal à cause de la faiblesse des résultats obtenus dans les années suivantes. En effet, si l’IA connaît aujourd’hui un tel développement, c’est grâce à un triptyque de technologies qui se sont développées en parallèle : la digitalisation qui permet de récupérer une quantité importante de données variées, l’augmentation des capacités de calcul et de stockage et la baisse importante de leurs coûts. Ces performances technologiques étaient largement inférieures il y a quelques décennies.

Les algorithmes d’IA se subdivisent en deux catégories : l’IA symbolique et l’IA connexionniste. La première représente les modèles dont les règles sont décrites par l’homme via des formules mathématiques et des programmes informatiques bien définis et bien connus. C’est le cas du programme DeepBlue qui a battu le champion du monde d’échecs Kasparov en 1996. Si ce type d’IA permet de retranscrire les raisonnements et connaissances humaines, il n’est pas exploitable lorsque les règles ne peuvent être écrites sous forme d’algorithmes. Un exemple parlant en est la classification de photo d’animaux. L’IA symbolique est inutilisable, car on ne peut pas décrire, en règle informatiques, le processus de reconnaissance des différents animaux (type de pelage, nombre de pattes, oreilles…). C’est là que l’IA connexionniste intervient, car elle englobe un ensemble d’algorithmes dit « Machine Learning ». Ces algorithmes permettent, avec quelques paramétrages et l’utilisation d’un volume important de données, d’apprendre de lui-même et de déterminer les meilleurs paramètres pour parvenir à une classification correcte. Cette IA connexionniste permet ainsi de repousser les limites de capacité de l’informatique et des modèles mathématiques.

À lire également

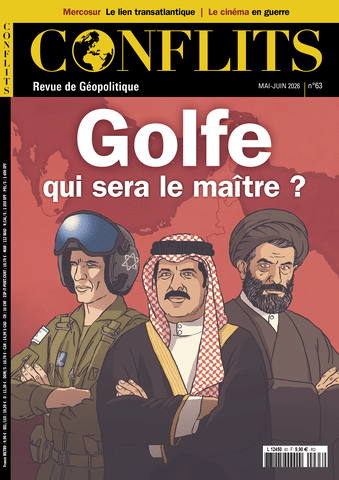

Nouveau Numéro spécial : Regards sur la guerre

Exemples impactés par l’IA

Cette technologie d’IA, associée avec d’autres innovations comme la miniaturisation, permet la création de systèmes innovants, utilisés en milieu civil comme militaire. L’armement voit ainsi l’arrivée de robots autonomes, le combat collaboratif et les Systèmes d’Armes Létaux Autonomes (SALA), qui apportent des changements importants dans la réalisation des missions militaires et soulèvent de nombreuses questions éthiques sur leur utilisation. Ces innovations ont aussi des répercussions sur le déroulement des combats. Cependant, l’IA s’applique aussi dans d’autres domaines qui, s’ils sont moins marquants, n’en sont pas moins influencés.

En effet, à partir du moment où les données forment un volume suffisamment important, l’utilisation de l’IA est possible. Le rapport sur « l’intelligence artificielle au service de la Défense »[2] met en avant, en plus de la robotique et du combat collaboratif, d’autres domaines comme l’aide à la décision à la planification, le renseignement, les opérations dans le cyberespace et du maintien en condition opérationnelle (MCO). Dans la branche de la MCO, l’IA sert à la maintenance prédictive. Ce type de maintenance vise à déterminer le meilleur moment de changement des pièces, en fonction de l’usure réelle de ces dernières. Cette connaissance très fine des systèmes est permise par les capteurs qui relèvent des données variées (vibrations, températures d’huile, nombre d’heures d’utilisation…) qui sont analysées par les algorithmes d’IA. La prise en compte de l’historique d’utilisation des systèmes et des experts du domaine de la maintenance augmente la finesse de l’analyse par l’IA. Mis ensemble, tous ces paramètres permettent ainsi d’effectuer les opérations de maintenance au meilleur moment.

L’IA a également sa place dans le domaine de la logistique. En effet, l’analyse de la multitude des données disponibles permet d’aller plus loin que les connaissances et capacités humaines, celles-ci étant limitées par la quantité des informations à prendre en compte. L’IA permet d’estimer avec efficacité les besoins futurs, et ainsi d’assurer une meilleure prévision des stocks nécessaires.

Dans le secteur de la surveillance, la numérisation des données et leurs analyses avec des programmes d’IA changent les modes de travail. En effet, la multiplication des images satellites nécessite un travail fastidieux de plusieurs années. Ces tâches ne pouvant pas être réalisées seulement par l’homme, l’IA intervient en automatisant le recueil d’informations relevées sur les images. Cela permet aux analystes de se concentrer sur l’analyse des informations recueillies par l’IA.

Ainsi, l’IA permet d’importants gains de temps dans les postes nécessitant un travail important de recueil, analyse et synthèse des informations. Il existe déjà des programmes d’IA permettant de synthétiser des informations, et même de créer des articles de journaux et des notes de synthèses à partir de sources d’informations variées.

Lien entre l’informatique et l’IA

Tous ces exemples d’applications sont permis par les algorithmes d’IA, qu’il faut voir comme des briques informatiques avec des algorithmes et des règles de fonctionnement spécifiques. En effet, un programme d’IA seul ne suffit pas : il faut l’associer à des algorithmes classiques pour affiner les résultats. Ainsi, Excel permet, depuis quelques années, d’insérer des données, avec l’IA, à partir d’une simple photographie d’un tableau.

L’informatique n’a pas attendu l’IA pour analyser des données de natures variées et synthétiser les résultats. Les FREMM[3] de la Marine disposent d’un système de gestion de combat (CMS)[4] qui, à partir des données de différents capteurs, donne une situation tactique. Dans ce cas d’usage, l’arrivée de l’IA représenterait une couche informatique supplémentaire qui permettrait d’aller plus loin dans l’analyse des données et l’aide à la décision[5].

La guerre nécessite aussi des prises de décisions tactiques. L’informatique ne pouvait pas simuler le jeu de go, à cause de la multiplicité des mouvements possibles. Le programme AlphaGo a utilisé le principe d’auto-apprentissage pour apprendre à jouer au go. Le programme connait les règles du jeu, joue et apprend seul en effectuant des milliers de parties. Les experts du go se sont aperçus que le programme proposait des mouvements de pièces qui n’étaient pas faux, mais auxquels ils n’avaient pas pensé[6]. Car en ne connaissant que les règles du jeu et en faisant ses propres entrainements, l’AlphaGo a créé des mouvements non influencés par les habitudes des joueurs.

Il pourrait ainsi, un jour, exister un programme d’IA en mesure d’élaborer des scénarios de stratégie. Mais les personnes qui utilisent le logiciel les prendront-ils en compte ou les considéreront-ils comme improbables, voire irréalisables ? Après tout, l’histoire présente des personnes dont les idées visionnaires, que nul ne prenait au sérieux, se sont finalement réalisées.

Dans les années 1960-70, l’informatique était vue comme une solution pour analyser de manière rapide et performante des données de natures variées et ainsi gagner de semaines de travail[7]. On attribue aujourd’hui ces mêmes qualités à l’IA. Toutefois, un aspect fondamental les distingue : les données ont tant gagné en volume et en diversité que les capacités humaines ne suffisent plus, à moins d’y passer des années.

De plus, tout comme l’apparition de l’informatique qui a permis de diminuer le brouillard de la guerre en apportant ses performances par rapport aux tâches manuelles, l’IA permet de le repousser encore, là où l’informatique a montré ses limites. Cependant, la complexité du monde actuel avec la diversité et le volume des sources d’informations (vidéo, audio, photo…) n’a fait que s’agrandir. L’IA ne permet-elle pas simplement de diminuer un brouillard qui a bien gagné en épaisseur ?

À lire également

Les sept piliers de la guerre asymétrique

La surconsommation des données

La capacité de l’IA permet la résolution de problématiques complexes. Son usage est donc pertinent lorsque la quantité et/ou la complexité des informations à traiter sont trop importantes. Il est alors tentant d’avoir recours à l’IA, d’autant plus qu’il y a une volonté de rendre l’IA explicable en la concevant pour qu’elle soit en mesure d’argumenter l’obtention du résultat final. Le risque, déjà bien présent avec la digitalisation, est d’arriver à une surconsommation des données, par excès d’analyses. Le risque principal est alors de perdre beaucoup de temps à multiplier des analyses sans grand intérêt. Mais, en situation de stress important, l’effet peut être inverse, vu la diminution de la quantité d’informations pouvant être prises en compte.

Une autre problématique est l’impact de la perte d’utilisation d’une IA. Cette situation se rencontre déjà avec des technologies telles que les moyens de communication, les données de surveillance et de positionnement. En période de conflit, elles peuvent se trouver hors d’usage et nécessiter une adaptation importante. L’impact de la perte d’usage d’un programme d’IA aurait-il le même type de conséquences ou serait-il amplifié par la complexité de la compréhension de cet algorithme ?

De plus, l’asymétrie des combats, entre deux armées aux moyens technologiques inégaux, serait encore accentuée avec l’usage de l’IA, en particulier l’IA nécessitant des jeux de données et des temps de recherches importants.

Une IA à améliorer sur certains points

Un autre cas d’analogie entre l’informatique et l’IA est la modification de photos et vidéos. Les logiciels déjà existants nécessitent du temps de mise en œuvre. L’IA peut, assez facilement, de modifier les photos et vidéos, comme le programme Deepfake permettant de transposer un visage sur une autre personne, voire de changer les paroles prononcées dans une vidéo.

Ces manipulations, qui permettent d’aller bien plus loin que les techniques précédentes, peuvent servir à la création de fausses informations. Une telle manipulation de l’information peut avoir un impact significatif, d’autant plus que les supports et capacités de communication actuels en permettent une diffusion très rapide et porteuse de conséquences pour les conflits. Cela s’est déjà vu : en 1870, le durcissement du ton de la dépêche d’Ems par le chancelier Bismarck a favorisé le déclenchement de la guerre franco-prussienne.

Si l’IA offre de nombreuses possibilités d’utilisation à plus ou moins bon escient, elle présente néanmoins, comme tout programme informatique, des faiblesses. Un cas concret est l’exemple adversaire sur des algorithmes utilisant des images. Prenons le cas d’un programme d’IA entraîné pour détecter différentes espèces d’animaux[8]. Une photo de panda sera bien catégorisée comme telle. Il suffit, cependant, d’ajouter du bruit dans l’image (indétectable à l’œil nu) pour que le programme donne une classification complètement différente.

En effet, le bon fonctionnement de l’IA dépend de la qualité des données utilisées. Une situation où les données seraient partiellement reçues ou fausses amènerait à une analyse erronée, avec des conséquences plus ou moins importantes selon la situation. De même, une mauvaise représentativité des données risquerait d’amener à des résultats moins fiables, voire des biais. L’IA ne fait que reproduire ce que les humains souhaitent qu’elle fasse ; elle reproduit donc les biais de ces derniers.

En plus de données de qualité, tout une infrastructure est nécessaire à la relève des données et leur stockage et de communication pour effectuer les échanges d’informations entre les différents supports (capteurs, serveurs de stockage, logiciel d’IA…), qui sont autant de points de faiblesses d’attaques physiques (destruction de site) ou immatérielles (piratage des algorithmes ou des données). Ils s’ajoutent à la liste des cibles potentielles en cas de conflits, en particulier dans le cyber.

Toutefois, ces fragilités ne sont nullement insurmontables. Les programmes informatiques présentent parfois des bugs et sont régulièrement améliorés et renforcés : il peut en être de même pour l’IA. En effet, de nombreuses méthodes d’analyses et de vérifications des risques et défaillances possibles, comme l’AMDEC[9] ou la SDF[10], sont utilisées pour la conception de logiciels ou d’autres types de produit. Il est tout à fait possible de les adapter au cas de l’IA et, ainsi, d‘augmenter la fiabilité et la résilience de son utilisation.

Si l’IA participe à la création de nouveaux types d’armements ou de systèmes, elle s’intègre aussi dans des cas d’usage existants en apportant sa capacité d’analyse, comme une brique supplémentaire à l’édifice des programmes informatiques. L’impact de l’IA est comparable à celui de l’informatique sur les armées et les conflits à ses débuts, mais n’en est pas un « copier-coller ».

Ainsi, lorsque l’informatique est apparue dans les années 1960-70, beaucoup de questions se sont posées, tant sur la fiabilité des programmes que sur la confiance dans la qualité des programmes informatiques, la gestion des données, ou la capacité à automatiser des tâches et à analyser de façon beaucoup plus rapide. Si ces questionnements semblent ne plus compter pour les autres branches de l’informatique, jugées très fiables à l’heure actuelle, ils sont d’actualité concernant l’IA.

Cependant, si depuis des décennies l’informatique s’est développée et a transformé le monde civil, les armées et aussi la guerre, l’arme qui fait le plus de victimes autour du monde est la Kalachnikov, une arme qui ne nécessite aucun usage informatique. Il est peu probable que l’arrivée de l’IA modifie ce statu quo.

De plus, l’utilisation actuelle de l’informatique a amené à accentuer les décalages technologiques déjà existants entre groupes armés. Le développement d’usage de l’IA ne changera pas cette situation. Elle pourrait même l’accentuer avec, en plus, une dépendance plus importante des data centers pour le stockage des données et des besoins réguliers de mise à jour des algorithmes.

Enfin, l’IA est fortement consommatrice d’électronique et de terres rares qui sont de plus en plus recherchées à travers la planète pour la digitalisation, la construction de batteries de voiture, de smartphones… ce qui pourrait amener à des tensions géopolitiques.

À lire également

Réseaux sociaux, conflits mondiaux

[1] Back, E. (2021, 6 mars). Deep Nostalgia : et soudain, les photos de vos ancêtres s’animent. Futura. https://www.futura-sciences.com/tech/actualites/intelligence-artificielle-deep-nostalgia-soudain-photos-vos-ancetres-animent-85984/

[2] Belli, T. (2019, 14 septembre). https://theatrum-belli.com/author/theatrum-belli/. Theatrum Belli. https://theatrum-belli.com/lintelligence-artificielle-au-service-de-la-defense-rapport-du-ministere-des-armees/

[3] Frégate Multimissions

[4] Systèmes de gestion de combat (CMS). Thales Group. https://www.thalesgroup.com/fr/worldwide/defense/notre-offre-forces-navales-lutte-de-surface/systemes-de-gestion-de-combat-cms

[5] Meddah, H. (2020, 26 septembre). [Infographie] Combat collaboratif, aide à la décision. . . Comment les armées s’emparent de l’IA. usinenouvelle.com. https://www.usinenouvelle.com/article/infographie-combat-collaboratif-aide-a-la-decision-comment-les-armees-s-emparent-de-l-ia.N1003844

[6] Zaffagni, M. (2017, 7 décembre). AlphaZero : l’IA de Google DeepMind devient imbattable aux échecs. Futura. https://www.futura-sciences.com/tech/actualites/technologie-alphazero-ia-google-deepmind-devient-imbattable-echecs-61409/

[7] L’informatique et la décision, Rapport de la grande commission Entreprises – École Supérieure de Guerre 1969-1970.

[8] Goodfellow, I. (2020, 5 octobre). Attacking Machine Learning with Adversarial Examples. OpenAI. https://openai.com/blog/adversarial-example-research/

[9] Analyse de Mode de Défaillance, de leurs effets et de leur Criticité.

[10] Sûreté de fonctionnement.